在人工智能領域,AI訓練長期占據著基礎設施討論的核心位置。大規模GPU集群、龐大的數據中心以及高能耗的模型訓練,一度成為衡量AI發展規模的重要指標。然而,隨著技術演進,AI訓練逐漸被視為發展的“前奏”,而真正考驗當前AI基礎設施能力的AI推理,正從幕后走向臺前,成為推動行業變革的關鍵力量。

AI推理是AI模型生命周期中的“應用”環節。經過訓練的模型通過處理新數據,生成答案、圖像或執行具體任務。與訓練過程高度集中于特定環境不同,推理的應用場景極為廣泛,覆蓋了從企業應用到消費設備的各個領域。隨著AI技術的普及,推理工作負載正以驚人的速度增長。以ChatGPT為例,這款產品僅用兩個月便吸引了1億月活躍用戶,遠超傳統技術或平臺的滲透速度。如今,AI正快速融入搜索、郵件、社交媒體等日常數字工具,這種集成并非漸進式發展,而是形成了爆發式的規模效應。

多模態AI的興起進一步加劇了對網絡的需求。傳統的文本交互逐漸被能夠同時處理文本、圖像、音頻和視頻的多模態交互取代。例如,一部智能手機的高清視頻流需要每秒數兆比特的持續帶寬支持。當數百萬用戶同時使用這類服務時,網絡中傳輸的數據量將呈指數級增長。現代推理模型通常將任務分解為多個內部步驟,用戶的一個簡單查詢可能觸發數十次后臺數據檢索。即使請求本身簡短,網絡也可能在后臺移動大量數據以完成響應。這種變化顯著增加了應用程序、數據源和AI模型之間的數據流動量。

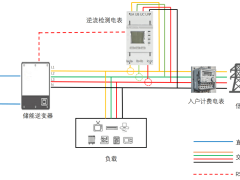

AI優先云的建設和分布是應對這一挑戰的重要方向。根據Ciena的調查,未來幾年,超過40%的新建數據中心將專注于AI領域,推理需求的激增正在推動推理中心和AI優先云區域的快速擴張。這些中心通過交換大量數據來降低延遲、提高系統彈性,并滿足數據主權要求。隨著AI深度融入日常數字體驗,推理能力需要更貼近用戶,同時保持對集中式數據和模型的訪問。這催生了兩種關鍵網絡能力:企業多云訪問和數據中心互連(DCI)。前者使企業和應用能夠輕松調用跨多個云和數據中心的AI服務,后者則通過低延遲連接在AI數據中心和云區域之間傳輸數據和推理流量。這兩種能力必須協同發展,形成AI優先云的連接框架。

光學連接成為支撐這一轉型的基礎設施。分布式推理的增長改變了網絡容量的規劃方式,無論是DCI還是企業多云訪問,都依賴于能夠承載高容量、低延遲流量的彈性光學網絡。先進的光傳輸技術通過最大化光纖吞吐量,同時降低每比特的成本、空間占用和能耗,為AI推理提供了必要的支持。自動化網絡控制系統則通過動態分配帶寬、優化流量路徑,并在AI工作負載實時變化時維護服務質量,進一步提升了網絡的適應性。

從數據中心內部連接到跨區域的光纖路由,光網絡構成了支持分布式推理的可擴展主干。沒有這種可靠、自適應的基礎設施,AI服務將難以在全球范圍內穩定交付。AI革命的核心不僅在于計算能力的提升,更在于網絡連接的優化。隨著推理從簡單的文本查詢轉向復雜的多模態交互,網絡和數據中心內的數據流動模式將發生根本性變化。這種轉變正在重新定義AI基礎設施的構建標準,為行業的未來發展鋪平道路。

Q&A

Q1:AI推理與AI訓練的主要區別是什么?

A:AI推理是AI模型生命周期中的“應用”階段,通過處理新數據生成結果或執行任務。與高度集中的訓練過程不同,推理的應用場景廣泛分布于各類設備和平臺。

Q2:多模態AI為何會增加網絡負擔?

A:多模態AI能夠同時處理文本、圖像、音頻和視頻,數據量巨大。例如,單個高清視頻流需要每秒數兆比特的帶寬支持,數百萬用戶同時使用時,網絡傳輸的數據量將急劇上升。

Q3:光學連接在AI推理中扮演什么角色?

A:光學連接為AI推理提供了高容量、低延遲的支持。先進的光傳輸技術提升了光纖的傳輸效率,同時降低了成本和能耗。光網絡從數據中心內部延伸到跨區域連接,構成了分布式推理的可擴展基礎設施。