在咖啡店忙碌的場景中,咖啡師能高效處理復雜訂單,無需逐字念出制作流程,這種內化的思考方式讓工作得以流暢進行。如今,英偉達的研究人員正將這種高效思維模式引入機器人領域。他們發布的Fast-ThinkAct研究,為機器人大腦帶來了一次關鍵升級,使其在處理復雜任務時既快速又精準。

過去幾年,視覺-語言-動作模型(VLA)是人工智能領域的熱門方向。這類模型為機器人賦予了“超級大腦”,使其能接收口頭指令,觀察環境并規劃動作完成任務。然而,最新研究發現,讓機器人在行動前先進行類似人類打草稿的推理,能顯著提升其完成復雜任務的能力。這種鏈式思維(CoT)方法,讓機器人像寫作文一樣逐步推導,但問題也隨之而來。

一個會思考的機器人在做決定前,可能需要生成約250個詞元的推理文字。在真實場景中,這種延遲是難以接受的。以工廠里的機器人手臂為例,它每秒需做出1到15次決策,若每次決策都要幾秒思考,生產線將嚴重受阻。在輔助手術或緊急救援等對時間敏感的場景中,延遲更可能帶來安全隱患。

為解決這一問題,Fast-ThinkAct研究團隊提出創新方案:讓機器人學會“心算”,將冗長的推理過程壓縮成幾個緊湊的“念頭”,即“可言語化的潛在推理”,然后直接據此行動。實驗表明,Fast-ThinkAct將機器人的推理時間縮短了高達89.3%,同時任務表現不僅未下降,反而有所提升。

Fast-ThinkAct的工作原理可通過“老師-學生”故事來理解。研究團隊先訓練一個教師模型,它面對機器人看到的場景和收到的指令,會生成完整的文字推理過程。例如,看到草莓在桌子右邊、抽屜在左前方時,教師模型會詳細規劃機械臂的移動步驟。該模型采用GRPO強化學習方法訓練,確保推理既合邏輯又能指導任務完成。教師生成的推理質量參差不齊,這卻成為訓練學生模型的關鍵素材。

學生模型的任務是將教師的長篇推理濃縮成幾個連續的潛在詞元。當教師需生成約250個文字詞元時,學生只需生成6個潛在詞元。為確保壓縮后的推理質量,研究團隊引入言語化器,它是一個小型語言模型,能將學生模型的抽象“精華”翻譯回人類可讀文字,以便研究人員檢查其是否學到教師推理的精髓。

訓練過程采用偏好學習策略,靈感來自DPO技術。研究團隊從教師模型生成的眾多推理版本中,挑出質量最高和最低的配對,讓學生模型學習生成能被言語化器解碼為高質量推理的精華。這就像訓練調酒師,讓其通過品嘗好酒和差酒的區別,真正理解好酒的味道。

除壓縮思考能力,機器人還需理解空間關系以完成實際任務。Fast-ThinkAct的第二個創新是視覺規劃的蒸餾。研究團隊引入動作對齊的視覺規劃蒸餾方法,教師模型在訓練中不僅學會語言推理,還學會用軌跡級獎勵指導自己,關注機器人手臂移動路徑的合理性。通過對齊教師和學生在關鍵位置的內部表征,確保學生模型雖說話簡短,但對空間的理解不打折扣。

為提升效率,研究團隊還設計空間詞元機制。傳統教師模型預測機器人手臂運動軌跡時,需逐個生成途經點坐標,描述5個路徑點可能要生成60到70個詞元。而學生模型使用5個專門的可學習空間詞元,每個空間詞元輸出通過簡單網絡層投影到路徑點坐標,大大提升了預測的并行性和速度。

有了壓縮推理和空間理解能力,最后一步是將這些智慧轉化為實際動作。Fast-ThinkAct框架的第三個核心組件是推理增強的策略學習。動作模型采用擴散Transformer架構,通過鍵值緩存提取學生模型處理空間詞元時產生的中間狀態,作為視覺規劃上下文傳遞給動作模型。動作模型的注意力機制同時關注視覺規劃上下文和直接感知觀察,做出符合高級規劃又適應當前情況的動作決策。訓練動作模型時,學生模型和視覺編碼器參數凍結,確保推理能力不被遺忘,動作模型專注于執行力提升。

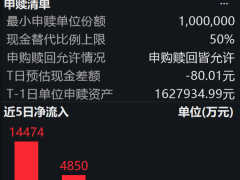

實驗驗證了Fast-ThinkAct的出色效果。與當時最先進的推理VLA模型ThinkAct-7B相比,Fast-ThinkAct推理延遲減少89.3%,每次決策時間從約7513毫秒降至約805毫秒,與同等規模的ThinkAct-3B相比也快了約7倍。在性能方面,Fast-ThinkAct在LIBERO基準測試中平均成功率達89.7%,超過所有對比方法;在SimplerEnv-Google測試中成功率達68.7%,略高于ThinkAct-7B;在更具挑戰性的RoboTwin2.0基準上,簡單模式平均成功率65.7%,困難模式26.4%,均超過基線方法,長程任務中表現尤為突出。

Fast-ThinkAct還展現出故障恢復、小樣本適應和長程規劃等特別能力。在RoboFAC基準上,它識別故障并提供恢復指導的能力出色,模擬環境得分91.1%,真實機器人環境得分78.9%,分別比第二名高出10.9分和16.4分。例如,機器人抓勺子抓空時,它能分析視頻并給出準確恢復建議。在RoboTwin2.0小樣本測試中,它在中等復雜度任務上成功率56.5%,長程任務上16.8%,顯著高于其他方法。對于長程規劃任務,其生成的視覺軌跡預測能準確描繪完成路徑,內部推理表征為動作執行提供有效指導。

研究團隊設計的言語化器讓我們能了解機器人的“內心世界”。對比教師模型原始推理和學生模型言語化推理輸出發現,學生模型推理更精煉且準確。例如在拿起玻璃杯任務中,學生模型推理更簡潔地表明任務成功完成;在判斷房間是否在一樓的例子中,學生模型注意到關鍵視覺線索給出正確答案,而教師模型推理冗長卻給出錯誤答案。

消融實驗驗證了框架各組件的貢獻。移除言語化損失后,模型在EgoPlan-Bench2和RoboVQA上得分下降;進一步移除蒸餾損失,性能繼續下降。完整Fast-ThinkAct比教師模型更快且性能更好,6個潛在詞元達到最佳平衡。不過,研究也存在局限性,言語化器基于預訓練語言模型構建,可能產生幻覺,但主要影響解釋性,對動作執行影響不大。