谷歌DeepMind首席執行官德米斯·哈薩比斯近日公開表示,將現有AI模型的規模擴展至極限是實現通用人工智能(AGI)的核心路徑。這位因推出Gemini 3模型備受矚目的技術領袖在上周的發言中強調,規模化發展不僅是當前AI進化的關鍵組成部分,甚至可能直接構成完整的AGI系統框架。

通用人工智能作為人工智能領域的終極目標,旨在創造具備人類同等或超越性智能的系統,能夠自主完成人類認知范圍內的所有任務。盡管全球頂尖科技企業均在此賽道投入重金研發,但目前該技術仍停留在理論階段。哈薩比斯在闡述觀點時指出,雖然單純依靠模型規模擴張可能推動AI向AGI演進,但最終突破或許需要額外的一兩個關鍵技術革新。

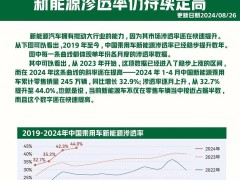

支撐其觀點的"規模定律"已成為AI行業的基礎性準則。這條經驗性規律揭示了模型參數規模、訓練數據量與計算資源投入之間的量化關系——當模型體量與數據量呈指數級增長時,系統性能將出現可預測的提升。這種"越大越聰明"的邏輯,使得科技巨頭們持續加碼建設超算中心,通過堆砌算力與數據來訓練更大規模的模型。

然而這種發展模式正面臨多重挑戰。公開可用的高質量訓練數據總量存在天然上限,而每增加一個數量級的算力投入,不僅意味著天文數字級的資金消耗,更將帶來指數級增長的能源消耗。有環境研究機構警告,若按當前速度擴張數據中心,到2030年AI訓練產生的碳排放可能相當于整個阿根廷的年排放量。更令行業擔憂的是,部分專家通過實證研究發現,當模型規模突破某個臨界點后,性能提升幅度開始出現明顯衰減。

在硅谷的另一端,前meta首席AI科學家楊立昆(Yann LeCun)公開質疑這種"規模至上"的路線。這位圖靈獎得主今年4月在新加坡國立大學演講時直言:"大多數真正復雜的認知問題,單純依靠擴大規模根本無法解決。"他以人類學習為例指出,嬰兒通過少量互動就能掌握物理世界規律,而當前大模型需要海量數據才能達到類似認知水平。

據知情人士透露,楊立昆離職meta后正在籌建的AI實驗室,將聚焦開發不依賴語言數據的"世界模型"。這種新型架構試圖通過模擬物理世界的空間關系與因果邏輯,讓機器像人類一樣通過觀察理解環境本質。該方案若能突破,或將顛覆現有以語言處理為核心的大模型技術路線,為AGI發展開辟全新路徑。目前已有多個研究團隊在類似方向取得階段性成果,但距離實用化仍存在巨大技術鴻溝。