字節跳動今日正式推出其新一代視頻創作模型Seedance 2.0,這款被業界寄予厚望的AI工具憑借多模態生成能力引發全球關注。該模型采用統一架構實現文字、圖片、音頻、視頻四種模態的聯合生成,支持同時輸入9張圖片、3段視頻和3段音頻進行創作,在復雜運動場景生成和工業級內容制作方面取得突破性進展。

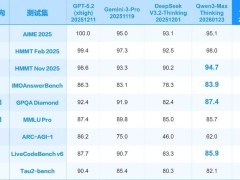

在技術評測中,Seedance 2.0展現出顯著優勢。其運動穩定性達到行業頂尖水平,能夠精準呈現雙人花樣滑冰的同步起跳、空中轉體等復雜動作,物理規律還原度較前代提升40%。雙聲道音頻技術可實現環境音、背景樂、解說聲的多軌并行輸出,在武俠對決場景中,刀劍碰撞聲與竹葉斷裂聲的時序誤差控制在0.1秒以內。模型支持15秒高質量多鏡頭輸出,配合智能運鏡規劃功能,普通用戶即可完成專業級分鏡設計。

這款工具的創作自由度引發創作者狂歡。通過多模態參考系統,用戶可上傳《蒙娜麗莎》等名畫作為視覺素材,讓畫中人物突破次元壁完成連續穿越。在測試案例中,模型成功實現"馬年全家福"的復雜指令:12位家庭成員的微表情與專屬動作在0.8秒內完成連貫切換,最終匯聚成動態全家福時,背景燈籠與春聯的點亮時序與人物動作完美同步。這種編導級控制能力,使視頻延長、局部修改等編輯操作變得像文字處理般便捷。

行業應用場景正在快速拓展。某電影特效團隊利用該模型將制作周期從3周壓縮至72小時,在測試案例中,20年代爵士俱樂部的查爾斯頓舞場景,流蘇裙擺的物理甩動軌跡與舞者汗珠的光影反射均達到電影級標準。商業廣告領域,模型自動生成的"可樂偷喝"創意視頻,通過畫中人物與現實場景的交互設計,使產品露出自然度提升65%。游戲開發者則利用其多主體一致性技術,實現百人戰場中每個角色的獨立動作邏輯。

盡管取得重大突破,開發團隊坦言模型仍存在改進空間。在超現實場景測試中,玻璃破碎的碎片分布偶爾出現物理失真,多人物對話時的口型同步準確率約為82%。針對這些問題,研發團隊正在優化三維空間建模算法,并建立更大規模的物理規律數據庫。目前用戶可通過即夢AI、豆包App及火山方舟體驗中心使用該工具,其中豆包平臺的移動端交互設計獲得創作者好評,通過滑動條即可精準控制生成視頻的時長與復雜度。