AI智能體正從技術概念加速落地為實際應用場景,全球主要科技企業均已推出相關產品。然而,這類系統在真實環境中的運行規律與用戶交互模式仍存在諸多未知領域。近日,AI研究機構Anthropic發布的最新報告,通過分析數百萬次人機交互數據,首次系統梳理了AI智能體的實際運行特征。

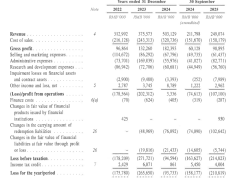

研究團隊對Claude Code開發工具的長期追蹤顯示,該系統的持續運行能力呈現顯著提升趨勢。在2025年10月至次年1月期間,其單次最長自主運行時長從25分鐘延長至45分鐘,增幅達80%。值得注意的是,這種增長并非單純源于模型升級,用戶信任度提升、任務復雜度增加以及產品優化等因素共同推動了這一變化。數據顯示,盡管中位數運行時長穩定在45秒左右,但極端值的變化反映出系統處理復雜任務的能力正在突破原有邊界。

用戶行為分析揭示了有趣的交互模式分化。經驗豐富的開發者更傾向于采用"零干預"模式,當使用次數超過750次時,近半數會話完全交由AI自主處理。相比之下,新手用戶僅在20%的場景中啟用全自動化模式。有趣的是,隨著使用經驗積累,用戶主動中斷AI運行的頻率反而從5%上升至9%,這表明專業用戶更善于在關鍵節點進行精準干預。在處理編譯器開發等高復雜度任務時,AI工具調用中的人工參與比例從87%降至67%,顯示出資深用戶對系統能力的深度信任。

系統自身的風險控制機制同樣值得關注。面對不確定情境時,Claude Code主動請求人類確認的頻率是用戶中斷操作的兩倍以上。在高風險場景中,這種自我校驗行為更為頻繁,形成獨特的安全防護網。研究指出,這種主動提問機制有效彌補了完全自動化帶來的潛在風險,為AI系統部署提供了重要的監督范式。

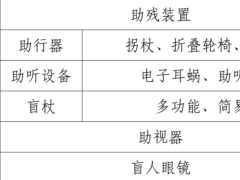

應用領域分布數據顯示,軟件工程占據AI智能體活動量的近半壁江山,但醫療、金融和網絡安全等高風險領域已出現創新應用。盡管嚴重風險事件目前僅占極小比例,但單個失誤可能引發重大后果的特性,促使研究團隊呼吁建立更完善的風險管控體系。當前監測發現,公共API執行的操作中,90%以上具有可逆性,這為風險控制提供了重要緩沖空間。

這項研究也存在明顯局限。由于僅能獲取單一模型提供商的數據,且對API會話的完整行為鏈缺乏全面觀察,部分結論可能存在偏差。基于此,研究團隊向行業提出多項建議:構建實時監控基礎設施、強化模型不確定性識別能力、開發用戶友好型監督工具,同時避免過早制定標準化交互規范,為技術創新保留彈性空間。