在人工智能大模型領域,一場關于效率與性能的深度變革正在悄然發生。隨著商業化場景對推理效率和成本控制的要求日益嚴苛,傳統以Softmax為核心注意力計算機制的架構逐漸暴露出局限性。這種機制在處理長文本時,計算量隨文本長度呈平方級增長,還需存儲大量KV緩存,給顯存帶來巨大壓力,難以滿足實際應用需求。

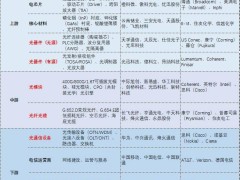

面對這一挑戰,業界積極探索新的技術路徑,主要形成了三條探索方向。稀疏注意力通過“少算”“有重點地算”提升效率,以DeepSeek為代表;滑動窗口注意力仍用Softmax計算,但只關注固定窗口內鄰近token,提高計算效率;線性注意力則徹底改寫Softmax公式,將復雜度從O(N2)降至O(N),推理成本大幅下降。然而,這三條路徑各有局限,如今業界紛紛轉向混合架構,尤其是混合線性注意力架構,成為行業探索的新焦點。

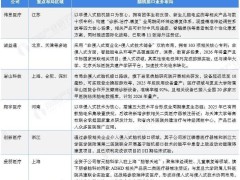

國內眾多大模型企業紛紛投身混合線性注意力架構的探索。2025年初,MiniMax率先發布Text - 01模型,采用1:7的混合線性注意力,在456B參數模型上成功落地,隨后MiniMax - M1模型也沿用此架構。當時團隊判斷混合架構將成為主流,但面臨基礎設施等瓶頸。

2025年下半年,探索迎來爆發期。去年9月,阿里通義實驗室發布下一代基礎模型架構Qwen3 - Next,在80B模型上完成驗證。該模型用線性注意力和門控注意力組合替換標準注意力,在1:3混合比例下性能超越單一架構,且線性注意力上下文學習能力更強。同樣在9月,螞蟻百靈團隊開源Ring - mini - linear - 2.0與Ring - flash - linear - 2.0,驗證Lightning Linear線性注意力在工業規模訓練和長上下文推理中的可用性,兩款模型采用1:7混合比例,高FLOP預算下表現優于純Softmax結構。螞蟻百靈還進行架構創新與基礎設施系統工程優化協同,打造FP8融合算子,將FP8混合精度訓練計算效率提升至原來的1.5 - 1.7倍,開發高效線性注意力融合算子提升推理引擎吞吐,使兩款Ring - linear模型在深度推理場景下成本僅為同尺寸稠密模型的約1/10,相較原有Ring系列成本下降超50%。

去年10月,月之暗面開源混合線性注意力架構Kimi Linear,其核心Kimi Delta Attention(KDA)是新型線性注意力模塊,通過細粒度設計改進門控delta規則,采用1:3混合比例,減少內存占用同時超越全注意力模型質量。

盡管這些探索在多維度驗證了混合線性注意力架構潛力,但多數成果停留在中小規模。真實應用中,大模型需面對萬億級參數、百萬級上下文窗口、高并發推理等工程挑戰,下一步關鍵是將技術探索推向超大規模模型,在工業級應用中驗證其可靠性、可擴展性與經濟價值。

將混合線性注意力架構推向萬億參數量級工程落地正在穩步推進。月之暗面創始人兼CEO楊植麟對混合線性注意力前景充滿信心,其團隊在Kimi Linear等項目中積累大量研究,計劃在下一代模型Kimi K3中引入更多架構優化,相信Kimi K3性能會有顯著提升。螞蟻百靈團隊也成果豐碩,接連推出超大型混合線性注意力架構模型Ling - 2.5 - 1T和全球首個混合線性注意力架構的萬億參數思考模型Ring - 2.5 - 1T。螞蟻百靈團隊通過增量訓練構建Ling 2.5架構,將GQA + Lightning Linear升級為MLA + Lightning Linear組合,壓縮KV緩存同時保留模型表達能力,采用1:7混合比例,保留QK Norm、Partial RoPE等核心機制確保性能不退化。在降本增效方面,Ling - 2.5 - 1T表現突出,僅需約6000個token平均輸出長度就能完成復雜任務,訪存規模壓縮至傳統架構1/10,生成吞吐量提升至3倍。

對混合線性注意力架構的探索,不僅關乎性能提升,更重新劃定大模型應用邊界與商業形態。當推理成本下降、token使用效率優化,模型調用成本不再是大規模落地核心瓶頸,應用范式將自然轉變。企業可將模型作為默認能力嵌入更多業務環節,實現更廣泛深入的效率提升。在搜索、推薦、智能客服等場景,大模型有望從傳統系統補充模塊轉變為核心驅動引擎,成為底層基礎設施。

不過,混合線性注意力架構探索之路并非一帆風順。不同技術路線仍在博弈驗證,如MiniMax在階段性探索后選擇回歸全注意力模型,優先保證復雜場景下穩定性與可靠性。但大模型競爭正從“暴力堆參數”轉向“工程效率的精算”這一趨勢愈發明顯,架構細微差異將在企業級落地中放大為成本優勢與體驗差距,推動大模型從“可用”邁向“好用”,走向廣泛普及。