在AI視頻生成領域,長期存在一個棘手難題:單鏡頭畫面雖能呈現驚艷效果,但構建長敘事時,畫面邏輯斷裂、角色形象突變等問題頻發。例如,前一個鏡頭主角還在溫馨的咖啡館,下一秒就可能突然出現在火星,甚至面部特征也完全改變。這種技術瓶頸嚴重制約了AI在長視頻創作領域的應用,成為行業亟待突破的關鍵挑戰。

近日,字節跳動與南洋理工大學聯合推出的開源框架StoryMem,為這一難題提供了創新性解決方案。該框架通過賦予AI類似人類的長期記憶能力,使其能夠精準掌控長鏡頭敘事,實現電影級的連貫性。這一突破不僅填補了技術空白,更重新定義了AI視頻生成的可能性邊界。

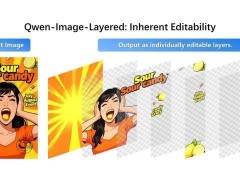

StoryMem的核心創新在于其獨特的M2V設計理念。傳統模型在生成視頻時,每個鏡頭獨立生成,缺乏前后關聯性,導致畫面風格割裂。而StoryMem通過構建動態記憶庫,在生成第一個鏡頭后,系統會自動提取關鍵幀信息并存儲。當生成后續鏡頭時,M2V LoRA模塊會將記憶庫中的視覺特征強制注入當前模型,確保新畫面與前作在角色、場景、光影等方面保持高度一致。這種機制無需依賴海量長視頻數據重新訓練,僅通過輕量級微調即可實現畫面連貫性。

實驗數據顯示,StoryMem在跨鏡頭一致性指標上較現有方法提升29%,顯著優于主流技術。在長達一分鐘的視頻中,角色服飾細節、面部特征、場景風格等均能保持統一,徹底解決了角色變臉和場景跳變問題。同時,系統會持續更新記憶庫,通過美學篩選和語義提取優化后續畫面,使故事敘事更加流暢自然。該框架完美繼承了基礎模型的高畫質基因,對用戶提示詞的理解能力也極為精準,能夠輕松實現復雜運鏡和自然轉場。

為驗證技術實力,研究團隊推出了包含300個復雜場景的ST-Bench基準測試集,涵蓋多角色互動、場景切換、風格變化等高難度任務。測試結果表明,StoryMem在各項指標上均表現優異,為行業樹立了新的技術標桿。這一成果不僅推動了AI視頻生成技術的進步,更為創意產業帶來了革命性變革。

在產業應用層面,StoryMem的開源特性使其迅速成為熱門工具。廣告與營銷領域,創意人員可快速將腳本轉化為動態分鏡,低成本進行多版本測試;影視制作團隊能利用其高效把控故事板視覺效果,大幅壓縮前期溝通成本;獨立創作者和短視頻博主則可借助該技術,突破技術壁壘,制作出劇情連貫的敘事短片。目前,開源社區已涌現出大量本地化部署方案,部分開發者在ComfyUI中搭建了初步工作流,推動這項技術加速普及。